Proxmox VE 9.x集群环境下配置ZFS共享

前提

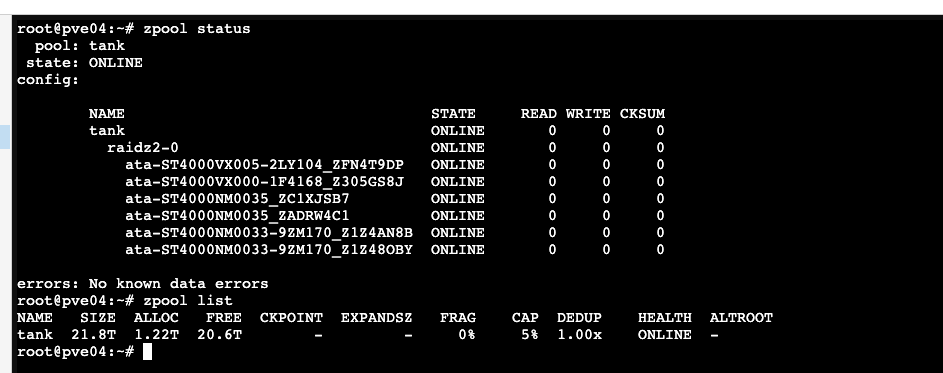

1 | 我这里是6块4T容量大硬盘做RAID-Z2 |

创建ZFS

1 | #假设磁盘 sda|sdb|sde|sdf|sdg|sdh,建议用 /dev/disk/by-id/xxx 建池,不建议直接用 /dev/sda,因为重启后盘符可能变化 |

1、创建 PVE 备份目录

1 | zfs create tank/pve-backup |

检查

1 | zfs list |

安装 NFS

1 | apt update |

配置 NFS 共享

1 | nano /etc/exports |

加入一行,假设你的 PVE 管理网段是 192.167.8.0/24:

1 | /backup/pve-vzdump 192.167.8.0/24(rw,sync,no_subtree_check,no_root_squash) |

生效

1 | exportfs -ra |

检查共享

1 | exportfs -v |

把 NFS 加到 PVE 集群 (可选,如果是集群环境)

1 | pvesm add nfs pve04-backup \ |

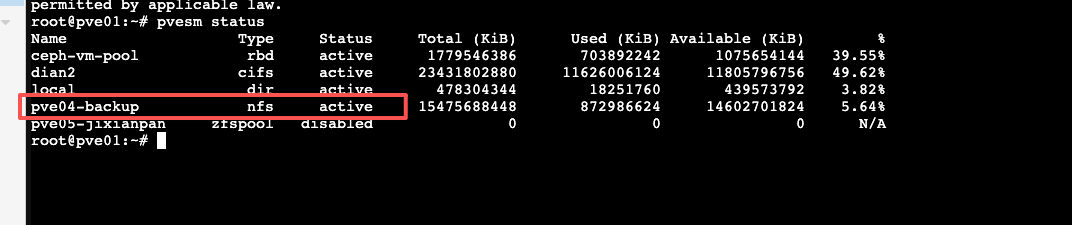

看到 pve04-backup 就成功。